Nhiều khả năng GPT-4 sẽ là bản nâng cấp lớn cuối cùng cho mô hình AI mà OpenAI cung cấp.

Một trong những phần làm nên các tính năng phong phú của ChatGPT chính là nhờ mô hình ngôn ngữ lớn đằng sau nó. Nếu như GPT-3 có kích thước lên đến 175 tỷ tham số, mô hình ngôn ngữ GPT-4 mới ra mắt được cho có quy mô lên đến hơn 1.000 tỷ tham số và được xem như các mô hình ngôn ngữ lớn chưa từng thấy cho đến thời điểm hiện tại.

Thế nhưng giữa tháng 4 vừa qua, chính CEO OpenAI, ông Sam Altman lại lên tiếng cảnh báo rằng thời đại của những mô hình ngôn ngữ lớn này đã kết thúc, mặc dù vậy vẫn chưa rõ điều gì sẽ thay thế cho chúng trong tương lai.

Trong một sự kiện do trường MIT tổ chức, ông Sam Altman cho biết: "Tôi nghĩ chúng ta đã đến điểm cuối của thời đại khi mọi người đều lao vào những mô hình siêu khổng lồ. Chúng tôi sẽ làm chúng tốt hơn theo một cách khác."

CEO OpenAI, Sam Altman. Ảnh internet

Lời tuyên bố của ông Altman cho thấy bước ngoặt không ngờ trong cuộc đua phát triển và triển khai các thuật toán AI mới. Kể từ khi OpenAI ra mắt ChatGPT vào tháng 11 năm ngoái, Microsoft đã sử dụng công nghệ nền tảng của nó để triển khai chatbot trong công cụ tìm kiếm Bing của mình, cũng như thúc đẩy hãng Google làm điều tương tự khi ra mắt chatbot Bard. Nhiều người cũng vội vã thử nghiệm loại hình AI mới này để hoàn thành công việc hoặc các việc làm cá nhân.

Tuyên bố của ông Altman cho thấy có thể GPT-4 là bản nâng cấp lớn cuối cùng cho chiến lược đã được OpenAI thực hiện trong vài năm qua – làm các mô hình với kích thước ngày càng lớn hơn và nạp vào ngày càng nhiều dữ liệu hơn.

Năm 2019, OpenAI giới thiệu mô hình ngôn ngữ đầu tiên của mình, GPT-2. Ở quy mô lớn nhất của mình, GPT-2 có khoảng 1,5 tỷ tham số với dung lượng 40GB văn bản. Tiếp đó năm 2020, GPT-3 ra mắt với 175 tỷ tham số và có dung lượng lưu trữ đến 800GB.

Mới đây nhất là mô hình GPT-4 – cho dù OpenAI không tiết lộ chính xác kích thước của mô hình này, nhưng nhiều chuyên gia trong ngành dự báo rằng, nó có thể lên tới 1.000 tỷ tham số, lớn nhất từ trước đến nay. Nhưng với tuyên bố nói trên của CEO OpenAI, cuộc đua tạo nên những mô hình ngôn ngữ quy mô lớn dường như đã kết thúc.

Lý do đằng sau tuyên bố bất ngờ này

Đầu tiên chính là chi phí. Cũng trong sự kiện của MIT nói trên, khi được hỏi có phải việc huấn luyện mô hình GPT-4 tiêu tốn đến 100 triệu USD, ông Altman đáp lại rằng: "Nó còn nhiều hơn thế." Kích thước mô hình lớn hơn, nghĩa là dữ liệu phải xử lý cũng lớn hơn, kéo theo chi phí tính toán xử lý dữ liệu cũng ngày càng lớn hơn.

Đó là còn chưa kể đến chi phí vận hành các mô hình này khi trả lời truy vấn của người dùng. Cho dù OpenAI và Microsoft không tiết lộ con số cụ thể nhưng nhiều chuyên gia trong ngành cho rằng, hiện tại việc vận hành ChatGPT tiêu tốn gần 1 triệu USD mỗi ngày. Con số này có thể tăng lên cao hơn nữa khi số người dùng chatbot này tiếp tục gia tăng.

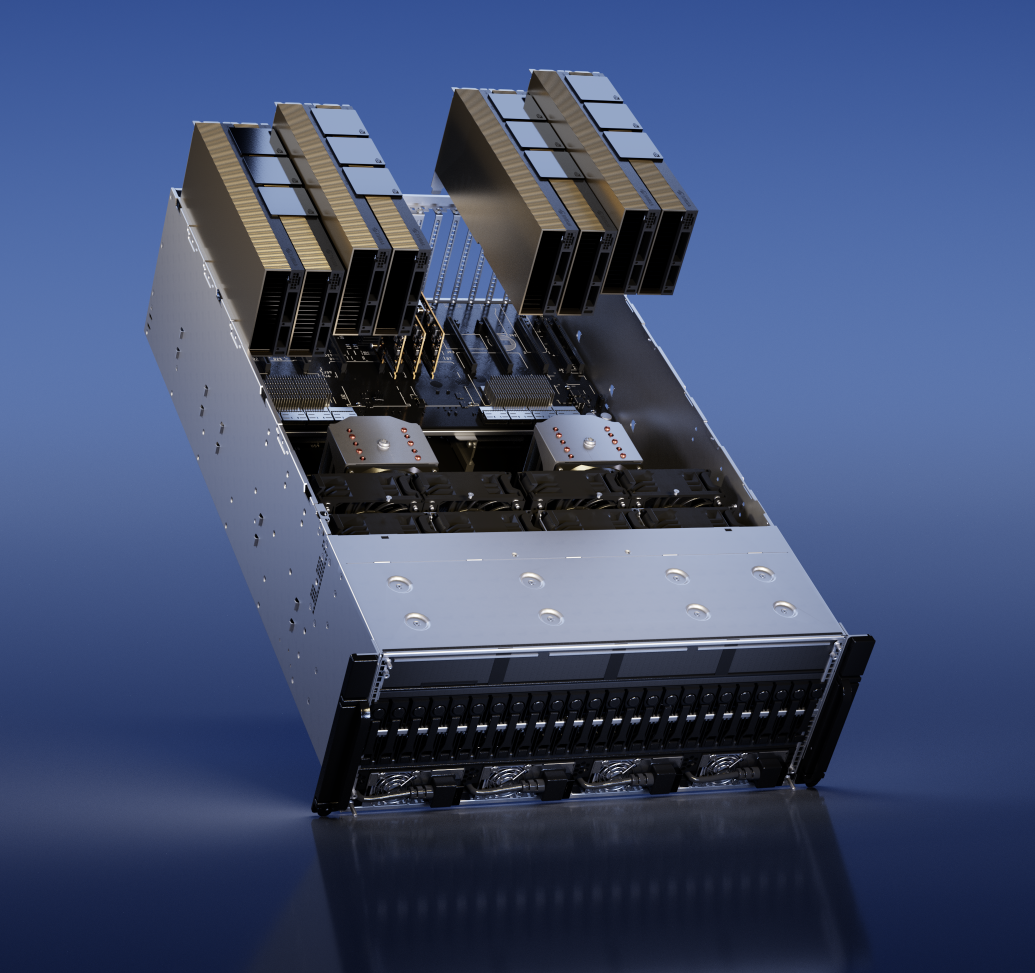

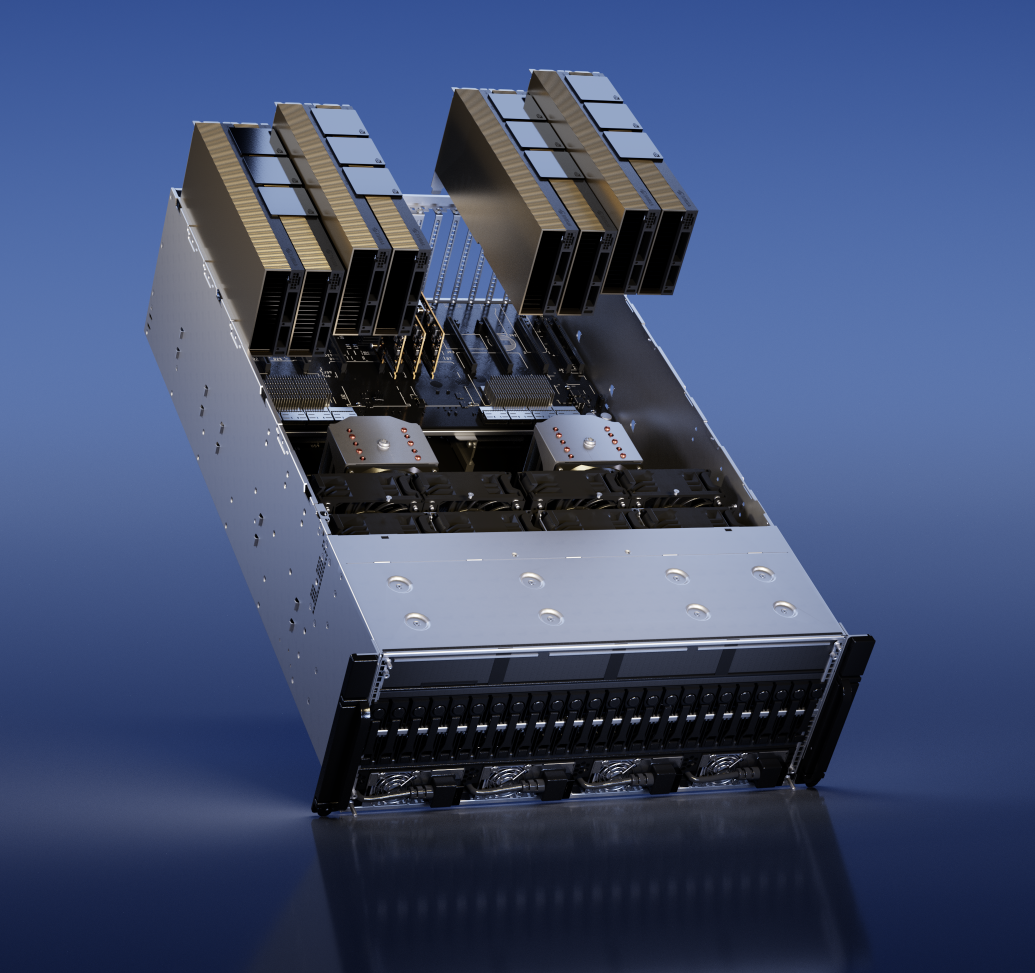

Một phần nguyên nhân dẫn đến mức chi phí khủng này đến từ giá thành cao ngất ngưởng của một loại linh kiện tối quan trọng: các GPU AI. Ví dụ, để huấn luyện nên ChatGPT, các báo cáo cho biết phải cần đến hơn 10.000 GPU A100 của Nvidia với giá thành lên đến 10.000 USD mỗi thiết bị. Thậm chí để vận hành ChatGPT, số lượng GPU cần thiết còn lớn hơn nữa, kéo theo chi phí càng lớn hơn nữa.

Mới đây, hãng Nvidia còn tiếp tục ra mắt dòng GPU H100 được thiết kế chuyên dành cho việc xử lý các tác vụ AI và tính toán hiệu suất cao. Nhưng giá thành của linh kiện này thậm chí còn đắt hơn nữa khi lên tới 30.000 USD mỗi sản phẩm, còn nếu mua lẻ trên eBay, mức giá phải trả còn cao hơn nữa. Các mô hình có quy mô càng lớn sẽ càng cần nhiều GPU hơn để huấn luyện và xử lý, dẫn đến chi phí càng lớn hơn.

Thậm chí một cuộc khủng hoảng nguồn cung của loại GPU này có thể xảy ra khi các linh kiện này không dành cho số đông người dùng. Giá thành cao, chỉ dành cho một số tập khách hàng nhất định, do vậy các GPU sẽ hiếm khi có sẵn để đáp ứng nhu cầu lớn của khách hàng. Mới đây ông Elon Musk cũng xác nhận việc sẽ mua 10.000 GPU để phát triển một công ty AI mới có tên X.ai. Thế nhưng nhiều chuyên gia trong ngành cho rằng, ông Musk có thể phải chờ nhiều tháng mới có được số lượng GPU mà mình yêu cầu.

GPU H100 HVL của Nvidia, GPU chuyên dành cho AI và các tác vụ tính toán hiệu năng cao. Ảnh internet

Bên cạnh đó trong tài liệu mô tả GPT-4, OpenAI cũng ước tính rằng hiệu quả từ việc mở rộng kích thước mô hình đang giảm dần – nghĩa là ngay cả khi kích thước khối dữ liệu tăng lên nhưng hiệu quả xử lý lại không tăng tương ứng. Ngoài ra ông Altman cho biết, còn có các giới hạn vật lý về số lượng trung tâm dữ liệu mà công ty có thể xây dựng và tốc độ xây dựng các trung tâm đó.

Nick Frosst, đồng sáng lập của Cohere, người trước đây từng làm việc về AI tại Google cũng đồng tình với tuyên bố cảu Sam Altman. Anh cũng tin rằng, sự tiến bộ của Transformer, loại mô hình máy học nằm trong trung tâm của GPT-4 và các mô hình AI đối thủ, không chỉ phụ thuộc vào quy mô của nó, mà còn các yếu tố khác, bao gồm thiết kế, kiến trúc hoặc khả năng tinh chỉnh mô hình cũng như phản hồi từ người huấn luyện…

Một trong những phần làm nên các tính năng phong phú của ChatGPT chính là nhờ mô hình ngôn ngữ lớn đằng sau nó. Nếu như GPT-3 có kích thước lên đến 175 tỷ tham số, mô hình ngôn ngữ GPT-4 mới ra mắt được cho có quy mô lên đến hơn 1.000 tỷ tham số và được xem như các mô hình ngôn ngữ lớn chưa từng thấy cho đến thời điểm hiện tại.

Thế nhưng giữa tháng 4 vừa qua, chính CEO OpenAI, ông Sam Altman lại lên tiếng cảnh báo rằng thời đại của những mô hình ngôn ngữ lớn này đã kết thúc, mặc dù vậy vẫn chưa rõ điều gì sẽ thay thế cho chúng trong tương lai.

Trong một sự kiện do trường MIT tổ chức, ông Sam Altman cho biết: "Tôi nghĩ chúng ta đã đến điểm cuối của thời đại khi mọi người đều lao vào những mô hình siêu khổng lồ. Chúng tôi sẽ làm chúng tốt hơn theo một cách khác."

CEO OpenAI, Sam Altman. Ảnh internet

Lời tuyên bố của ông Altman cho thấy bước ngoặt không ngờ trong cuộc đua phát triển và triển khai các thuật toán AI mới. Kể từ khi OpenAI ra mắt ChatGPT vào tháng 11 năm ngoái, Microsoft đã sử dụng công nghệ nền tảng của nó để triển khai chatbot trong công cụ tìm kiếm Bing của mình, cũng như thúc đẩy hãng Google làm điều tương tự khi ra mắt chatbot Bard. Nhiều người cũng vội vã thử nghiệm loại hình AI mới này để hoàn thành công việc hoặc các việc làm cá nhân.

Tuyên bố của ông Altman cho thấy có thể GPT-4 là bản nâng cấp lớn cuối cùng cho chiến lược đã được OpenAI thực hiện trong vài năm qua – làm các mô hình với kích thước ngày càng lớn hơn và nạp vào ngày càng nhiều dữ liệu hơn.

Năm 2019, OpenAI giới thiệu mô hình ngôn ngữ đầu tiên của mình, GPT-2. Ở quy mô lớn nhất của mình, GPT-2 có khoảng 1,5 tỷ tham số với dung lượng 40GB văn bản. Tiếp đó năm 2020, GPT-3 ra mắt với 175 tỷ tham số và có dung lượng lưu trữ đến 800GB.

Mới đây nhất là mô hình GPT-4 – cho dù OpenAI không tiết lộ chính xác kích thước của mô hình này, nhưng nhiều chuyên gia trong ngành dự báo rằng, nó có thể lên tới 1.000 tỷ tham số, lớn nhất từ trước đến nay. Nhưng với tuyên bố nói trên của CEO OpenAI, cuộc đua tạo nên những mô hình ngôn ngữ quy mô lớn dường như đã kết thúc.

Lý do đằng sau tuyên bố bất ngờ này

Đầu tiên chính là chi phí. Cũng trong sự kiện của MIT nói trên, khi được hỏi có phải việc huấn luyện mô hình GPT-4 tiêu tốn đến 100 triệu USD, ông Altman đáp lại rằng: "Nó còn nhiều hơn thế." Kích thước mô hình lớn hơn, nghĩa là dữ liệu phải xử lý cũng lớn hơn, kéo theo chi phí tính toán xử lý dữ liệu cũng ngày càng lớn hơn.

Đó là còn chưa kể đến chi phí vận hành các mô hình này khi trả lời truy vấn của người dùng. Cho dù OpenAI và Microsoft không tiết lộ con số cụ thể nhưng nhiều chuyên gia trong ngành cho rằng, hiện tại việc vận hành ChatGPT tiêu tốn gần 1 triệu USD mỗi ngày. Con số này có thể tăng lên cao hơn nữa khi số người dùng chatbot này tiếp tục gia tăng.

Một phần nguyên nhân dẫn đến mức chi phí khủng này đến từ giá thành cao ngất ngưởng của một loại linh kiện tối quan trọng: các GPU AI. Ví dụ, để huấn luyện nên ChatGPT, các báo cáo cho biết phải cần đến hơn 10.000 GPU A100 của Nvidia với giá thành lên đến 10.000 USD mỗi thiết bị. Thậm chí để vận hành ChatGPT, số lượng GPU cần thiết còn lớn hơn nữa, kéo theo chi phí càng lớn hơn nữa.

Mới đây, hãng Nvidia còn tiếp tục ra mắt dòng GPU H100 được thiết kế chuyên dành cho việc xử lý các tác vụ AI và tính toán hiệu suất cao. Nhưng giá thành của linh kiện này thậm chí còn đắt hơn nữa khi lên tới 30.000 USD mỗi sản phẩm, còn nếu mua lẻ trên eBay, mức giá phải trả còn cao hơn nữa. Các mô hình có quy mô càng lớn sẽ càng cần nhiều GPU hơn để huấn luyện và xử lý, dẫn đến chi phí càng lớn hơn.

Thậm chí một cuộc khủng hoảng nguồn cung của loại GPU này có thể xảy ra khi các linh kiện này không dành cho số đông người dùng. Giá thành cao, chỉ dành cho một số tập khách hàng nhất định, do vậy các GPU sẽ hiếm khi có sẵn để đáp ứng nhu cầu lớn của khách hàng. Mới đây ông Elon Musk cũng xác nhận việc sẽ mua 10.000 GPU để phát triển một công ty AI mới có tên X.ai. Thế nhưng nhiều chuyên gia trong ngành cho rằng, ông Musk có thể phải chờ nhiều tháng mới có được số lượng GPU mà mình yêu cầu.

GPU H100 HVL của Nvidia, GPU chuyên dành cho AI và các tác vụ tính toán hiệu năng cao. Ảnh internet

Bên cạnh đó trong tài liệu mô tả GPT-4, OpenAI cũng ước tính rằng hiệu quả từ việc mở rộng kích thước mô hình đang giảm dần – nghĩa là ngay cả khi kích thước khối dữ liệu tăng lên nhưng hiệu quả xử lý lại không tăng tương ứng. Ngoài ra ông Altman cho biết, còn có các giới hạn vật lý về số lượng trung tâm dữ liệu mà công ty có thể xây dựng và tốc độ xây dựng các trung tâm đó.

Nick Frosst, đồng sáng lập của Cohere, người trước đây từng làm việc về AI tại Google cũng đồng tình với tuyên bố cảu Sam Altman. Anh cũng tin rằng, sự tiến bộ của Transformer, loại mô hình máy học nằm trong trung tâm của GPT-4 và các mô hình AI đối thủ, không chỉ phụ thuộc vào quy mô của nó, mà còn các yếu tố khác, bao gồm thiết kế, kiến trúc hoặc khả năng tinh chỉnh mô hình cũng như phản hồi từ người huấn luyện…

Theo Thanh Niên